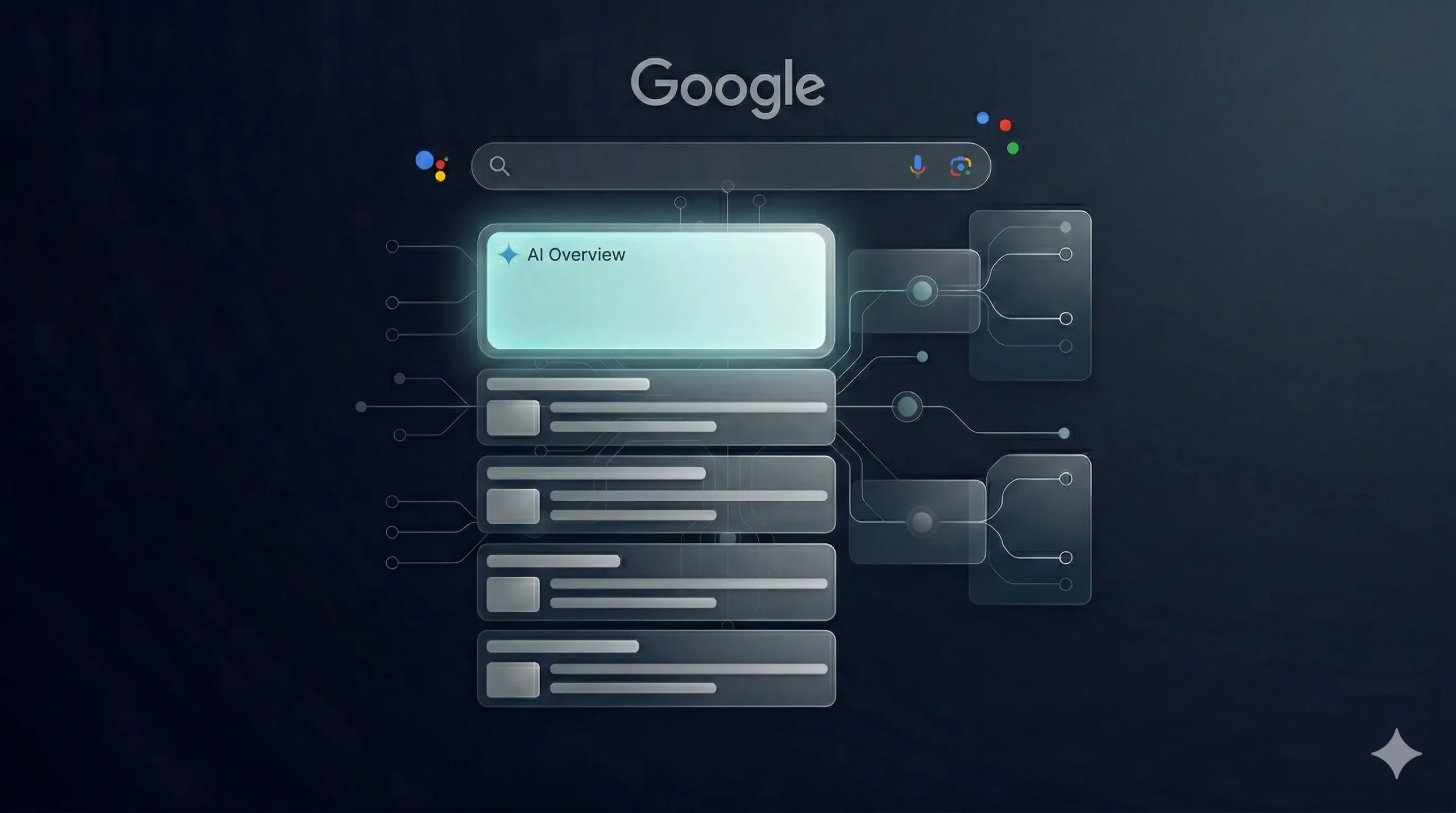

SGE (AI Overviews) için Teknik Site Mimarisi: Yapay Zekâ Çağında Görünürlük Rehberi

Google’ın SGE / AI Overviews yaklaşımıyla arama sonuçları artık “10 mavi link” mantığından çıkıp, çoklu kaynaktan derlenmiş yanıtlar üretmeye başladı. Bu yeni düzende hedef sadece sıralama almak değil; yapay zekânın seni doğru anlaması, güvenmesi ve gerektiğinde kaynak göstermesi. Upper4AI perspektifinden buna “LLM Görünürlüğü” diyoruz. “Yapay zekâ görünürlüğü” ifadesini de aynı kavramın eş anlamlısı olarak kullanabilirsin.

Bu rehberde, sitenin teknik mimarisini LLM’lerin okuma–anlama–alıntılama davranışına göre nasıl kurman gerektiğini anlatıyorum. Amaç: içeriğinin yalnızca indekslenmesi değil, AI yanıtlarında kullanılabilir ve referanslanabilir hale gelmesi.

Yönetici Özeti: SGE/AI Overviews çağında LLM görünürlüğü; keşif, anlama ve kaynak seçimi için doğru site mimarisi, schema, llms.txt ve parçalanabilir içerik bloklarıyla kurulur.

SGE / AI Overviews hangi siteleri daha kolay kullanır?

AI Overviews çoğu zaman “en uzun” içeriği değil, en iyi yapılandırılmış ve en kolay alıntılanabilir içeriği tercih eder. Öne çıkan sinyaller şunlardır:

- Net soru–yanıt kurgusu (Answerability)

- Tutarlı başlık hiyerarşisi (H1–H2–H3)

- Varlıkların (entity) açık tanımı ve ilişkilerinin netliği

- Kısa, tek fikirli ve kaynaklanabilir paragraflar

- Temiz HTML ve hızlı sayfa deneyimi

- Tutarlı schema.org/JSON-LD katmanı

- Güçlü iç link ağı ve konu kümeleri (topic cluster)

Geleneksel SEO vs SGE Optimizasyonu

| Boyut | Geleneksel SEO | SGE / AI Overviews (LLM Görünürlüğü) |

|---|---|---|

| Hedef | Sıralama (rank) | Yanıta girme + kaynak seçilme |

| İçerik biçimi | Uzun anlatım | Parçalanabilir bloklar + Q&A |

| Ana sinyal | Keyword + backlink | Varlık netliği + tutarlılık + kanıt |

| Teknik öncelik | Crawl + index | Parse + extract + trust |

| Yapı | Blog yazıları | Hub–cluster + anlam ağı |

| Başarı ölçümü | Trafik, sıralama | AI yanıtlarında görünme, atıf, marka anılması |

LLM’ler için teknik site mimarisinin 6 temel katmanı

- Bilgi mimarisi: Hub → Cluster → Support

LLM görünürlüğü için içerik rastgele blog yazılarından oluşmamalı. En azından şu yapı gerekir:

- Hub: Ana konu sayfası (ör. “LLM Visibility / LLM-SEO”)

- Cluster: Hub’ı besleyen alt rehberler (SGE, entity graph, schema, FAQ, ölçümleme)

- Support: Sık sorular, kısa rehberler, checklist’ler ve örnekler

Bu yapı hem kullanıcı hem de sistemler için “konu derinliği” üretir. Sonuçta site, “tekil yazılar” değil, bir “bilgi haritası” gibi görünmeye başlar.

- İç linkleme: Anlam ağı (Entity Graph) kurmak

LLM’ler tek sayfa okumuyor; sitenin genel tutarlılığını tarıyor. İç linkleme, klasik “SEO linkleme” değil; anlamsal bir navigasyon olmalı.

- Her cluster yazı, hub sayfaya dönmeli

- Her yazı en az 3–5 ilgili yazıya bağlanmalı

- Link metinleri “anlam taşımalı” (genel ifadeler yerine net kavram)

Bu yaklaşımı özellikle “Entity Graph (Varlık Ağı)” yazılarınla birlikte bir standart haline getirmen, sitenin “tekil içerik” değil “tutarlı varlık” olarak algılanmasını güçlendirir.

- HTML yapısı: Parçalanabilir içerik üretmek

AI sistemleri içeriği bloklara böler ve “en işe yarar parçayı” seçer. Bu yüzden sayfayı şöyle kurgulamak gerekir:

- Her H2 altında tek amaç

- Paragraflar kısa ve tek fikirli

- Listeler ve tablolar (özellikle kıyas tabloları) kontrollü ve okunabilir

- Gereksiz görsel şişkinliği ve karmaşık HTML yok

Pratik kural: Bir paragraf tek başına alındığında bile anlamlı olmalı.

- Schema.org + JSON-LD: Makine okur katmanı

Schema, LLM görünürlüğünde iki kritik şeyi güçlendirir: varlık netliği ve bağlam.

Minimum set:

- Organization / LocalBusiness (Upper4AI)

- WebSite + SearchAction

- WebPage

- BlogPosting (her yazıda)

- BreadcrumbList

- Uygunsa FAQPage

Buradaki kritik nokta “eklemek” değil; @id mantığının tutarlı olması, sameAs alanlarının doğru olması ve sayfalar arası bütünlüğün korunmasıdır. “JSON-LD: İnsan Dilinden Makine Anlamına Çeviri” yazına burada mutlaka iç link ver.

- llms.txt + sitemap + robots: Keşif kanalını optimize etmek

Yeni nesil yapay zekâ sistemleri ve tarayıcılar için keşif maliyetini düşürmek büyük fark yaratır.

llms.txt konusunda somut not:

llms.txt, sitenizin kök dizininde yer alan ve LLM’lerin (ChatGPT, Perplexity vb.) sitenizi saniyeler içinde anlamasını sağlayan bir markdown özetidir. Amaç “mucize” değil; önemli sayfaları ve sitenin odak alanını net bir şekilde işaretlemektir.

Bunun yanında:

- sitemap.xml güncel, temiz ve doğru URL’leri içermeli

- robots.txt kritik sayfaları yanlışlıkla engellememeli

- E-E-A-T + kanıt yapısı: Kaynak olarak seçilmek

AI Overviews, emin olmadığı içeriği alıntılamak istemez. Bu nedenle “güven” katmanı, artık teknik mimarinin parçasıdır.

- Yazar/kurum bilgisi şeffaf olmalı

- İddialar ölçülebilir veya gerekçeli olmalı

- Gerektiğinde seçici dış kaynak verilmelidir

- Güncelleme tarihi, sürüm mantığı ve içerik kapsam sınırları net olmalıdır

Bu kısmı “E-E-A-T ve LLM Performansı” yazına bağlaman, seri bütünlüğünü güçlendirir ve okuyucuyu doğal akışla derinleştirir.

Uygulanabilir checklist

- Hub–cluster yapı kuruldu mu?

- Her yazı hub’a bağlanıyor mu?

- İç linkler semantik mi ve yeterli mi?

- H2 blokları tek amaçlı mı?

- Paragraflar alıntılanabilir mi?

- BlogPosting JSON-LD var mı?

- Organization + WebSite schema tutarlı mı?

- sitemap.xml güncel mi?

- llms.txt hazır mı?

- Yazar/kurum + güncelleme alanları var mı?

SGE / AI Overviews çağında rekabet “kim daha çok yazdı” değil; “kim daha net, daha güvenilir ve daha kullanılabilir bilgi üretti” üzerinden yürüyor. Teknik site mimarisi, LLM görünürlüğünün altyapısıdır: içeriğinin bulunmasını, anlaşılmasını ve gerektiğinde kaynak olarak seçilmesini kolaylaştırır.

Bu içerik, Upper4AI Dijital Görünürlük Projesi kapsamında hazırlanmıştır.